PENTAHO PDI+APACHE HOP+TALEND: principais ETLs open source

Juntos as três principais ferramentas de mercado para ingestão e tratamento de dados

What you will learn

PENTAHO PDI: O que é o Pentaho PDI

PENTAHO PDI: Entendendo sobre fluxos de trabalho e pipelines

PENTAHO PDI: Entendendo sobre projetos e ambientes

PENTAHO PDI: Instalando o Pentaho PDI

PENTAHO PDI: Criando pipelines com arquivos texto

PENTAHO PDI: Realizando tratamento de dados para entendimento do processo de engenharia de dados

PENTAHO PDI: O que são transformações, Jobs e ações dentro de um pipeline

PENTAHO PDI: Construindo um workflow com Jobs, orquestrador da sequência das operações

PENTAHO PDI: Entendendo os menus principais e o seu GUI e seus componentes

PENTAHO PDI: Comp. pipelines: Sort, Select value, CSV file input, Value mapper, Filter rows, Dummy, Unique rows, Merge Join, Text File Output, Row Normaliser

PENTAHO PDI: Entendendo como podem ser depurados os dados via output, logs

PENTAHO PDI: Number Range, Concat Field, String Operations, Replace in String, IF Field Value is Null, Split Fields, CSV File Input, Mail, File Exist

PENTAHO PDI: Leitura de dados em uma API: Rest Client, JSON Input, JSON Output

PENTAHO PDI: Construindo Workflow com execução de pipelines

PENTAHO PDI: Entendo o uso de variáveis globais no PENTAHO PDI

PENTAHO PDI: Automatização de pipeline ou workflow

PENTAHO PDI: Construindo pipelines em banco de dados Postgresql: Table Input, Table Output, Configurando conexão

PENTAHO PDI: Instalação de banco de dados Postgresql, uso do PGAdmin

PENTAHO PDI: Automatização de JOBs e Transformações com o Kitchen e Pan

PENTAHO PDI: Construção do projeto de dados a sua escolha e correção com o uso do Pentaho PDI

APACHE HOP: O que é Hop Orchestration Platform

APACHE HOP: Entendendo sobre projetos e ambientes

APACHE HOP: Entendendo sobre fluxos de trabalho e pipelines

APACHE HOP: Instalação do APACHE HOP

APACHE HOP: Criando pipelines com arquivos texto

APACHE HOP: Realizando tratamento de dados para entendimento do processo de engenharia de dados

APACHE HOP: O que são transformações, links e ações dentro de um pipeline

APACHE HOP: Construindo um workflow, orquestrador da sequência das operações

APACHE HOP: Entendendo o HOP GUI e seus componentes

APACHE HOP: Entendendo menu barras, principal e perspectivas

APACHE HOP: Criando sua área de projetos

APACHE HOP: Componentes pipelines: Sort, Select value, CSV file input, Value mapper, Filter rows, Dummy, Unique rows, Merge Join, Text File Output

APACHE HOP: Entendendo o que é : View output, Preview output , Debug output

APACHE HOP: Number Range, Concat Field, String Operations, Replace in String, IF Field Value is Null, Split Fields, CSV File Input, Mail, File Exist

APACHE HOP: Leitura de dados em uma API: Rest Client, JSON Input, JSON Output

APACHE HOP: Construindo Workflow com execução de pipelines

APACHE HOP: Entendo o uso de variáveis globais no APACHE HOP

APACHE HOP: Automatização de pipeline ou workflow pelo HOP-RUN

APACHE HOP: Construindo pipelines em banco de dados Postgresql: Table Input, Table Output, Configurando conexão

APACHE HOP: Instalação de banco de dados Postgresql, usando PGAdmin

TALEND: Como trabalhar com a ferramenta ETL Open Source Talend Data integration

TALEND: Para que funciona uma ferramenta ETL

TALEND: Como realizar a integração de dados dentro do Talend Data integration

TALEND: Principais componentes do Talend: TFILEARCHIVE, TFILEUNARCHIVE,TFILECOMPARE E TFILEOUTPUTDELIMETED ,TFILECOPY E TFILELIST,TFILEDELETE E TJAVA

TALEND: Mais componentes: TFILEEXIST E TMSGBOX,TFILEROWCOUNT,TAGGREGATEROW, TSORTROW E TLOGROW, TREPLACE E TFILTERCOLUMN

TALEND: Mais componentes: TFILTERROW,TSPLITROW,TFILEINPUTXML, TLOGCATCHER , TROWGENERATION,TDIE E TLOGROW

TALEND: Mais componentes:TLOGCATCHER , TROWGENERATION,TWARN E TLOGROW ,TSENDMAIL

TALEND: Como exportar um projeto de desenvolvimento para produção

TALEND: Como importar um projeto para produção

TALEND: Aprendendo o uso das conhecidas variáveis de contexto

Why take this course?

Você terá neste treinamento as três principais ferramentas de ETL open source - Pentaho PDI, Apache Hop e Talend - é uma excelente oportunidade para quem deseja se aprofundar neste campo em constante evolução e crescimento.

A utilização de ferramentas ETL é essencial para empresas que precisam extrair, transformar e carregar dados de diversas fontes para seus sistemas e bancos de dados. E com a crescente demanda por análises mais avançadas, as ferramentas de ETL têm se tornado cada vez mais relevantes.

O Pentaho PDI é uma ferramenta extremamente poderosa, capaz de realizar diversas tarefas de ETL, incluindo a extração de dados de diferentes fontes, a transformação desses dados e a carga nos bancos de dados alvo. O Apache Hop é outro grande nome no mundo de ETL open source, oferecendo uma plataforma escalável e flexível para processamento de dados. Já o Talend é uma ferramenta completa que oferece recursos avançados de integração de dados, além da possibilidade de integração com outras ferramentas de BI.

É importante ressaltar que, embora cada ferramenta tenha suas particularidades, é fundamental que você tenha conhecimento das três para estarem preparados para os mais diversos cenários do mercado. Isso porque as empresas estão buscando profissionais capazes de lidar com múltiplas ferramentas, e que possam implementar soluções eficazes em diferentes contextos.

As principais funcionalidades de cada uma das ferramentas, apresentando seus pontos fortes e diferenciais:

Pentaho PDI:

Integração com diferentes fontes de dados, incluindo bancos de dados, arquivos e serviços web;

Design visual e intuitivo para criação de fluxos de dados e transformações;

Capacidade de executar em cluster, garantindo escalabilidade e performance;

Possibilidade de conexão com outras ferramentas Pentaho.

Apache Hop:

Design visual e intuitivo para construção de pipelines completos de ETL;

Grande variedade de plugins disponíveis, permitindo integração com diferentes fontes de dados e plataformas de processamento;

Suporte a diversas linguagens de programação, incluindo Java, Python e JavaScript;

Alto nível de personalização e controle do processo de ETL.

Talend:

Amplificador de produtividade no desenvolvimento de processos ETL, possui grande variedade de componentes pré-fabricados, facilitando bastante a construção dos mesmos;

Amplificador de conectividade, permitem que você se conecte com todas as suas fontes de dados, incluindo dados estruturados e não estruturados em tempo real;

Conjuntos de recursos avançados para governança de dados, permitindo maior controle e segurança na gestão dos mesmos;

Integração com outras ferramentas de BI e Analytics.

Além disso, vale destacar que o mercado de trabalho está em constante expansão nessa área, e profissionais capacitados em ETL são cada vez mais requisitados por empresas de diversos segmentos. Com o mercado de Big Data crescendo exponencialmente, a demanda por profissionais que possam extrair informações valiosas desses dados é gigantesca.

Portanto, convido você interessado em se destacar no mercado de trabalho a se matricularem no nosso curso completo, que apresenta as principais funcionalidades dessas ferramentas, suas diferenças e particularidades. Não perca a chance de adquirir novos conhecimentos e habilidades que podem fazer toda a diferença na sua carreira!

Reviews

Charts

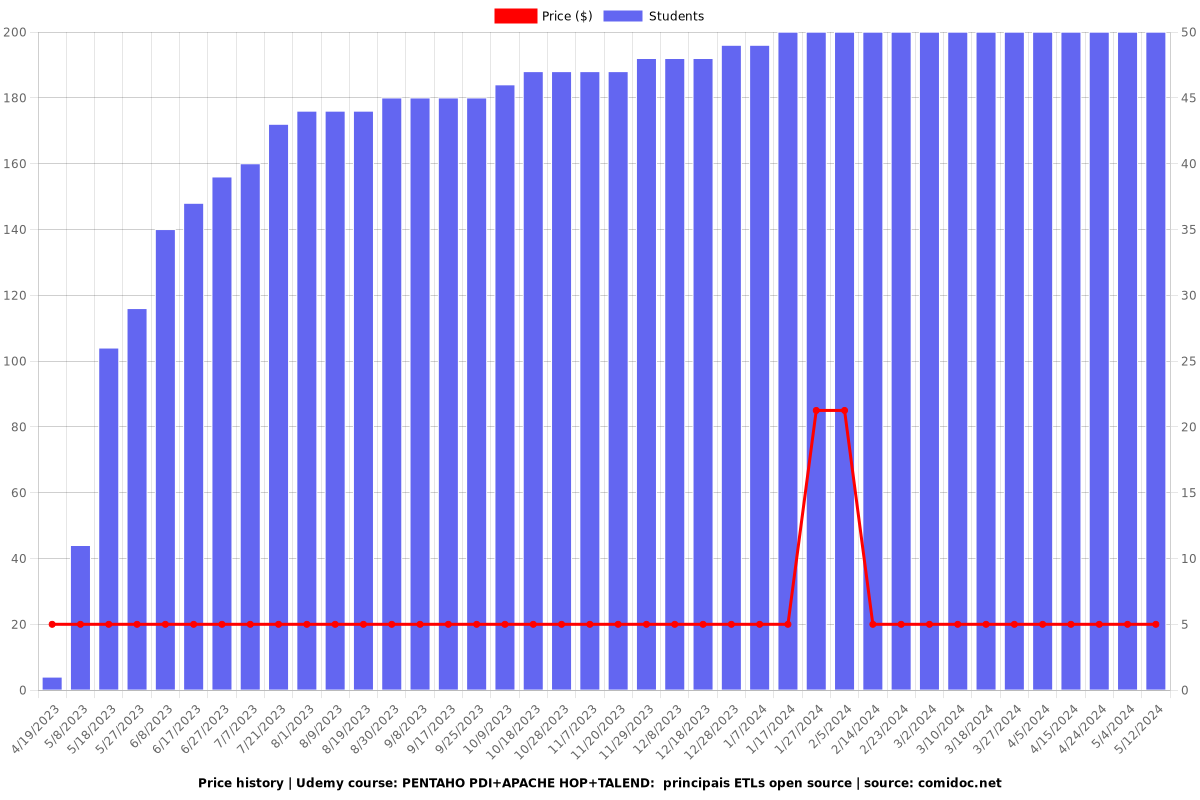

Price

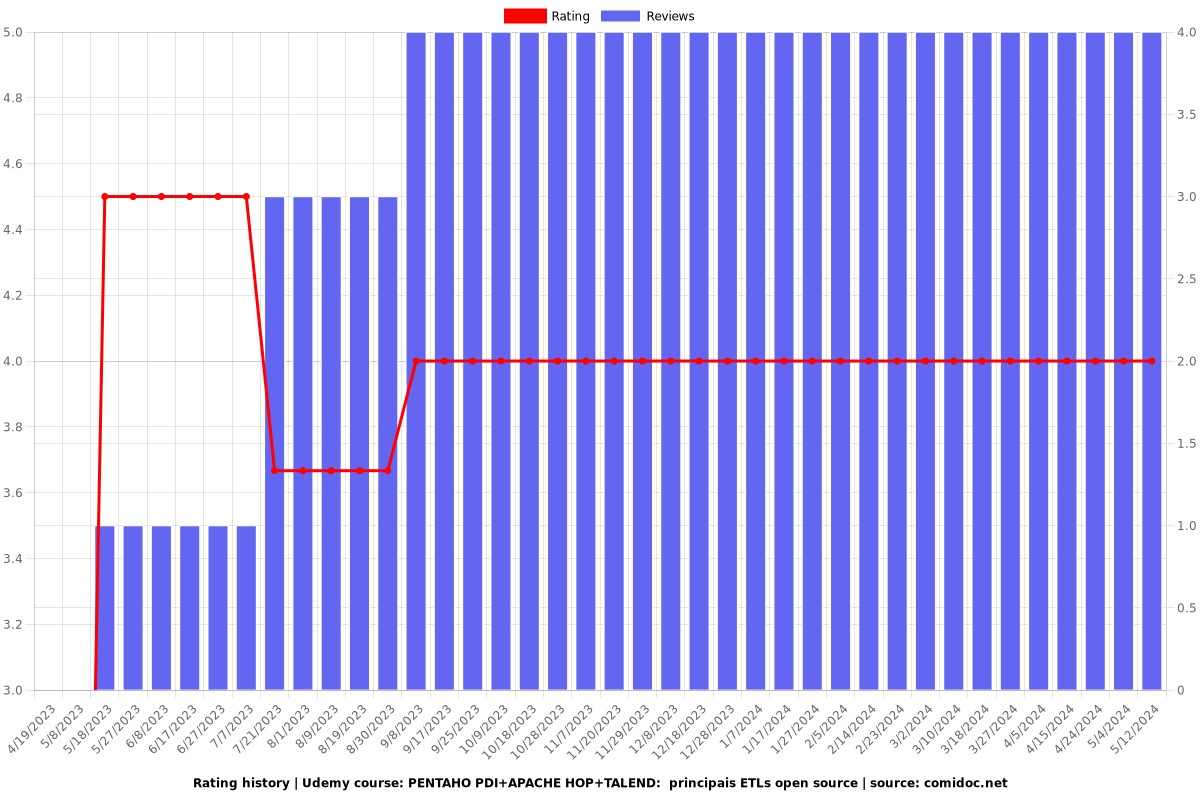

Rating

Enrollment distribution