Python自然语言处理-BERT实战

NLP-BERT实战

4.31 (61 reviews)

376

students

8 hours

content

Feb 2020

last update

$44.99

regular price

What you will learn

掌握NLP当下核心算法模型

熟练掌握Transformer网络架构

熟悉注意力机制的作用(Attention)

熟练掌握BERT模型原理及应用

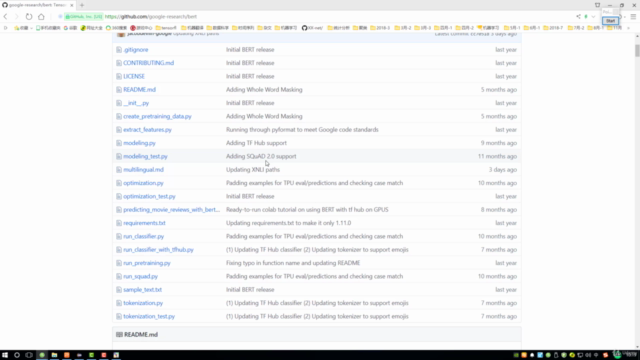

熟练使用谷歌开源项目BERT

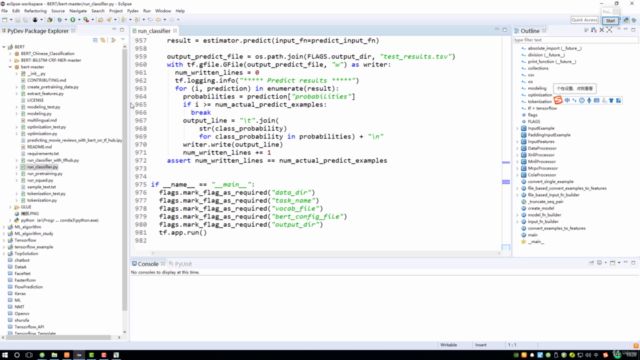

基于BERT开源模型构建自己的项目

将预训练模型应用到自己的任务中

熟悉当下NLP常规解决方案

Screenshots

Related Topics

2683950

udemy ID

12/2/2019

course created date

12/5/2019

course indexed date

Bot

course submited by