Databricks e PySpark: analisando dados

Saiba trabalhar em alto nível na área de dados

What you will learn

Visualização para explorar resultados de consultas de diferentes perspectivas

Construção de gráficos e Dashboards

Unificação de dados em diversos formatos: texto, JSON, PARQUET, dentre outros

Trabalhada por administrador da plataforma, analista de dados, cientista de dados e engenheiro de dados com diversas funcionalidades

Aprendizado processamento distribuído em SPARK

Entendo o que é Databricks File System (DBFS) seu sistema de arquivos

Entendo sobre Cluster

Aprendendo a gerenciar e criar Notebooks em R, SCALA, Python e SQL

Executando scripts multilinguagens

Gerenciando a ingestão de dados e análise de dados, gerando gráficos e dashboards

Construindo na versão community

Trabalhando com a biblioteca dbutils Python

Integrando o Databricks ao Power BI

O que é PYSPARK

O que é SPARK

Instalando o SPARK em um ambiente Windows, configurando

Instalando o ANACONDA

Instalando a JDK

Entendendo o ecossistema : Apache Spark + Anaconda + JAVA

Entendendo o conceito de NÓ, CLUSTER

Conhecendo os módulos e pacotes do PYSPARK

O que é SparkContext

Entendo o que é RDD (Resilient Distributed Dataset)

Trabalhando com Spark Dataframe

Compreendendo as diferenças entre transformações e ações, operações com PYSPARK

Operações: collect, count, parallelize, getNumPartitions, textFile, first, filter, cache, Show, take

Aprendendo o que é uma função Lambda

Operações: flatMap, map, reduceByKey, sortBY, join, leftOuterjoin, rightOuterjoin, select, groupBy, orderBy

Monitoramento de jobs com SPARK UI

O que é SparkSession

Leitura de arquivos externos

SPARK SQL

Leitura de dados em JSON

Why take this course?

Trazemos para você o que há de mais completo e atual no uso de ferramentas da área de dados nas grandes corporações pelo mundo, o uso do Databricks e do PySpark.

O Databricks é um ecossistema completo que reúne as principais linguagens da era Data Science em um mesmo notebook, isso mesmo, um dos poucos produtos que possui multilinguagem em um mesmo notebook. Você vai trabalhar com Linguagem R, Python, Scala e ainda utilizando comandos em SQL, umas das linguagens de manipulação de dados mais utilizadas no mundo. Além disso, você produzirá gráficos no ambiente do Databricks, que já vem preparado para isso, tudo junto.

Depois mergulharemos com tudo no uso do PySpark. Para quem não conhece, é o uso do PYTHON na estrutura de processamento SPARK, que vem revolucionando o mercado pela sua rapidez na execução de suas rotinas de trabalho. Com PySpark vamos aprender conceitos diferentes, trabalhar dados estruturados, semi-estruturados e não-estruturados, você terá vários scripts para executar durante o seu aprendizado.

Databricks e Pyspark são destaque na era BIg Data, pois utilizam os conceitos de processamento distribuído e podem ser acessados e utilizados na nuvem, que já é muito comum nas empresas.

Você vai contar com apostila, exercícios resolvidos e desafios para correção, não é o máximo?

Então venha e una-se ao nosso grupo.

Screenshots

Reviews

Charts

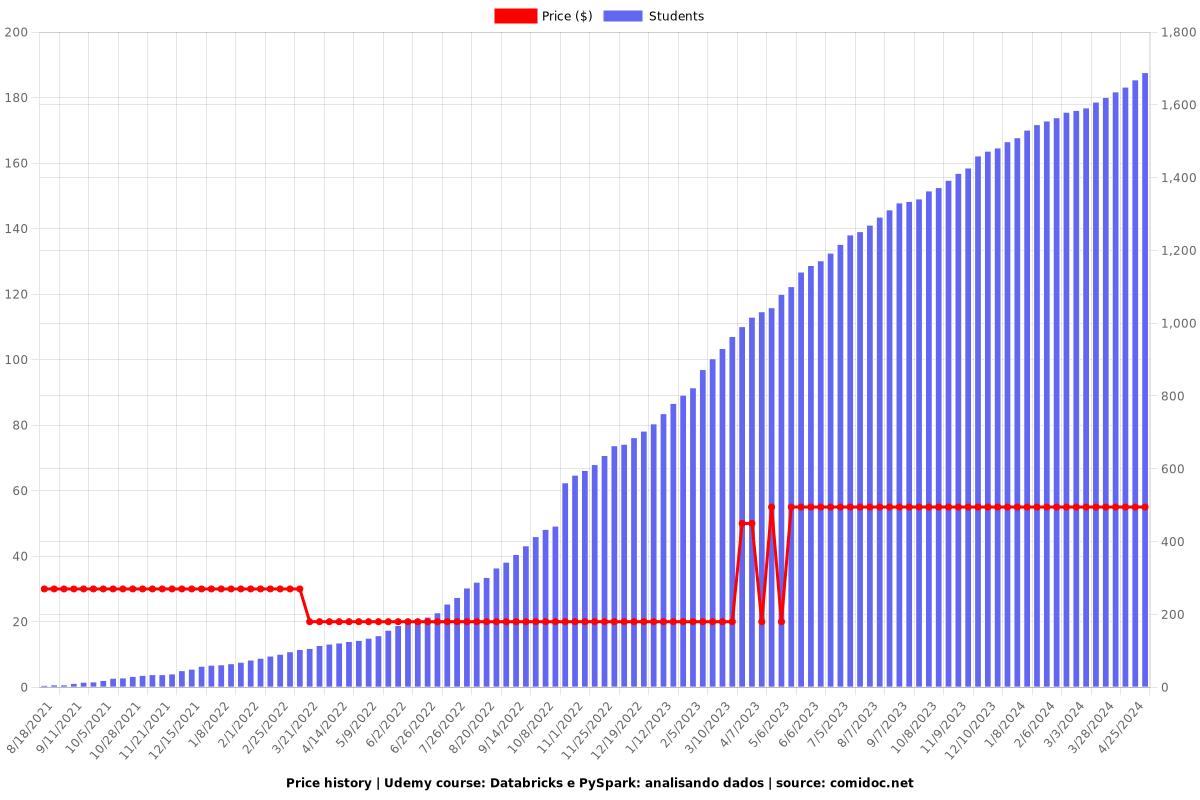

Price

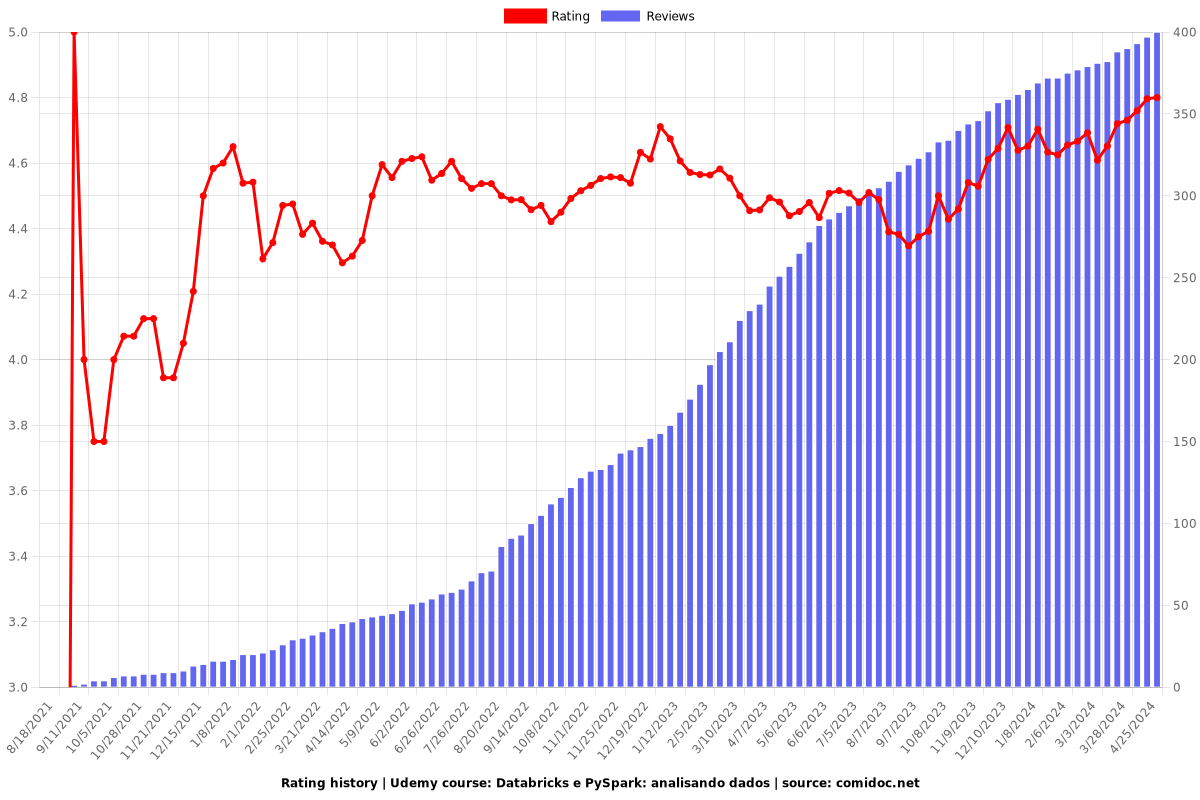

Rating

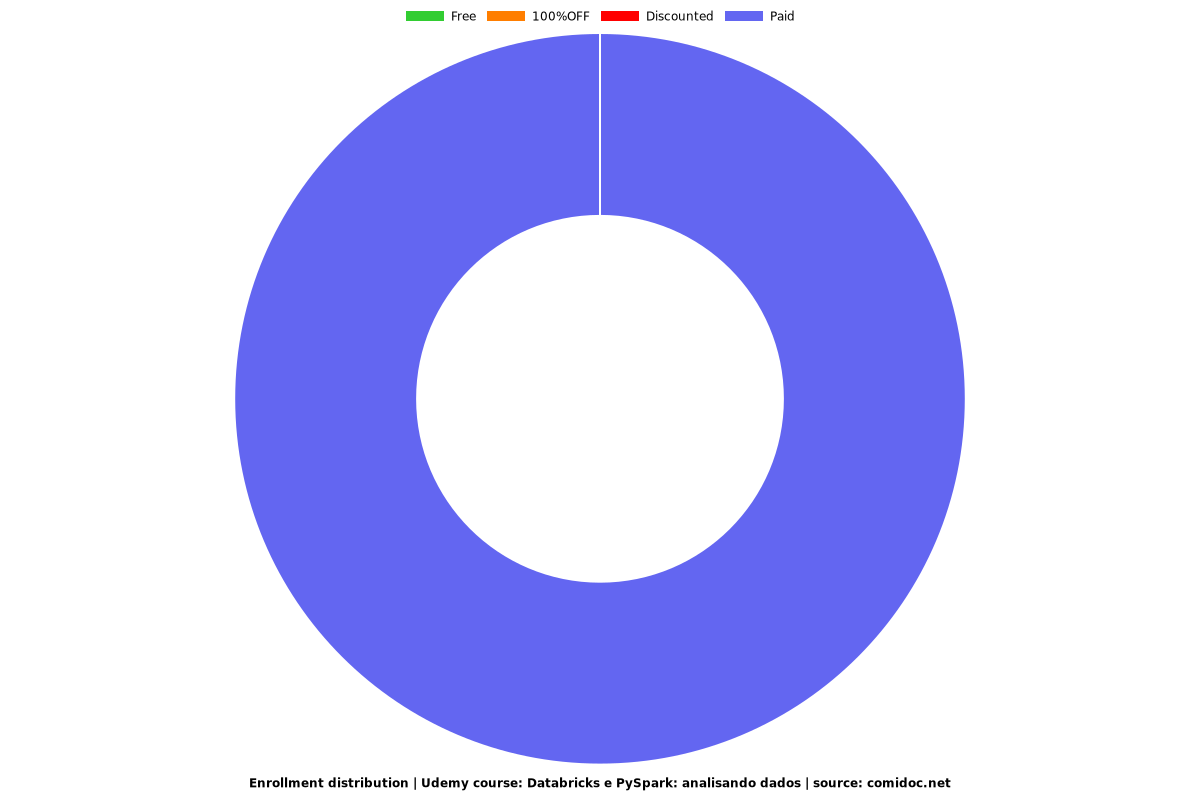

Enrollment distribution