ベイズ推定とグラフィカルモデル:コンピュータビジョン基礎1

Learn essence of "Computer Vision: Models, Learning, and Inference"

4.21 (1649 reviews)

15,536

students

10.5 hours

content

Aug 2015

last update

FREE

regular price

What you will learn

確率変数,同時確率,条件付き確率,周辺化,ベイズの定理を説明できる

ベルヌーイ分布,ベータ分布,ディリクレ分布,正規分布,逆ガンマ分布,逆ウィシャート分布,それらの共役関係を説明できる

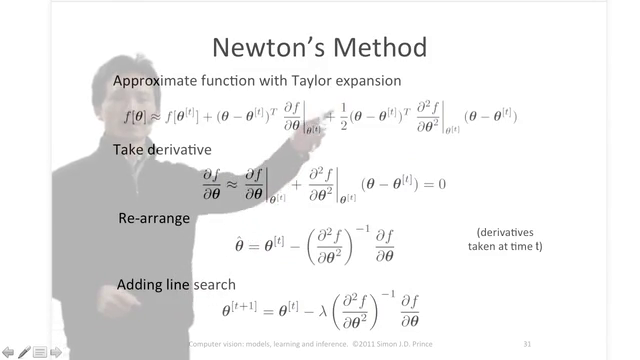

正規分布やカテゴリ型分布などのパラメータを,最尤推定,事後確率最大推定,ベイズ推定で求められる

正規分布の性質(共分散,共分散の分解,変数の線形変換,周辺分布,条件付き分布)を説明できる

識別モデルと生成モデルにおける回帰と識別(線形回帰・ロジスティック回帰)と,その応用例を理解できる

複雑な確率分布を,潜在変数を用いた混合分布で表現する方法(EMアルゴリズム,混合正規分布,robust t-distribution, factor analysis)を理解できる

回帰モデル(線形回帰,ベイズ線形回帰,非線形回帰,カーネル回帰,Gaussian process regression,Relevance vector regression)を理解できる

識別モデル(ロジスティック回帰,ベイズ・非線形・双対・カーネルロジスティック回帰,Relevance vector machine, ブースティング,Random trees/forests/ferns)を理解できる

グラフィカルモデルと,そこにおける変数の条件付き独立を説明できるようになる

chain型(HMM)とtree型のグラフィカルモデルにおけるMAP推定と周辺分布最大推定を理解できる

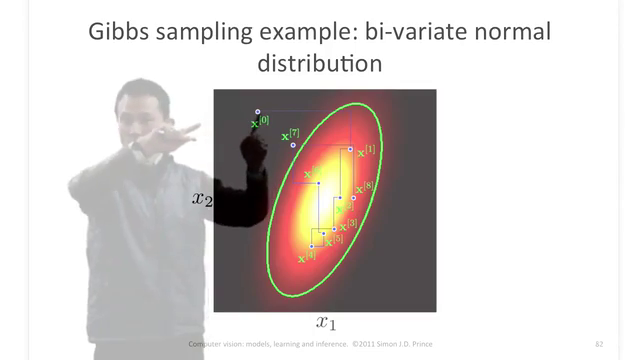

動的計画法(DP),forward-backwardアルゴリズム,確率伝播(belief propagation, BP)アルゴリズム,和積(sum-product)アルゴリズムを理解できる

grid型のグラフィカルモデル(MRF)におけるMAP推定をグラフカットを用いて解く方法を理解できる

max flow / min cutとMRFの関係を説明できる

2値・多値のMRFのための適切なグラフカットを説明できる

MRFにおける列モジュラ性の重要性を理解できる

コンピュータビジョンにおける統計的機械学習の応用を理解できる

Screenshots

Related Topics

52106

udemy ID

5/3/2013

course created date

11/7/2019

course indexed date

Bot

course submited by